堅實底層架構!Agentic AI 顛覆式創新re:Invent 2025 Peter & Dave 主題演講回顧

- DIGITIMES / 台北

- 2025-12-05 00:00:00

(拉斯維加斯,2025 年 12 月 5 日)AWS re:Invent 2025 倒數第二日,AWS 公用運算高級副總裁 Peter DeSantis 聯同 AWS 運算與機器學習服務副總裁 Dave Brown,帶來了一場技術為本的主題演講《基礎設施創新,系統地闡述了 AI 時代雲端基礎設施的核心價值。

一系列重點發布,包括由 AWS Graviton5 處理器(預覽) 至 AWS Lambda Managed Instances、從 Project Mantle 推論引擎到 Amazon S3 Vectors 向量儲存、再到 Amazon Trainium3 UltraServers 和 Amazon Trainium4 晶片,全面展示了 AWS 從 Amazon Nitro 到 AWS Graviton 再到 Amazon Trainium 的自行研發晶片策略,如何為客戶創造無與倫比的效能和成本優勢。

AI 時代:雲端運算的「基本功」更為重要

Peter DeSantis 開場即提出一個觀點:AI 正在改變應用程式開發方式,但雲端運算的核心屬性不僅不會改變,反而變得更為關鍵。

- 資安:AI 讓攻擊者也更有效率,雲端服務供應商必須將資安列為首要優先項目。

- 可用性:AI 應用程式規模空前,需要經過最嚴苛工作負載考驗的雲端基礎設施。

- 彈性:AI 工作負載需求激增,客戶期望獲得與 Amazon S3 相同的彈性體驗。

- 成本:AI 訓練和推論成本極高,降低成本成為關鍵競爭力。

- 敏捷性:AI 轉型充滿不確定性,需要快速啟動、優化和調整的能力。

圖說:AWS 公用運算高級副總裁 Peter DeSantis。

AWS 的自行研發晶片策略源於對這些核心屬性的深刻理解。Peter DeSantis 回顧了 2010 年 Amazon EC2 面對的虛擬化效能抖動問題。當時業界普遍認為虛擬化永遠無法達到裸機效能,但 AWS 透過深入優化,最終開發出 Amazon Nitro 系統,將虛擬化從伺服器轉移到專屬硬體,完全消除了抖動問題,效能甚至超越裸機。

Amazon Nitro 的成功開啟了 AWS 的自行研發晶片之路,證明了控制晶片、硬體和系統架構能夠實現商用硬體無法達到的效能和效率提升。這一理念延續到 AWS Graviton 伺服器處理器和 Amazon Trainium AI 加速器的開發。值得一提的是,Amazon Nitro 系統的技術成就已被納入電腦科學經典教材《電腦組織與設計(Computer Organization and Design)第 7 版,成為電腦科學教育的一部分。

圖說:Amazon Nitro 的成功開啟了 AWS 的自行研發晶片之路。

AWS Graviton5(預覽):架構突破帶來效能飛躍

架構創新與效能飛躍

AWS 運算與機器學習服務副總裁 Dave Brown 上台,宣布推出 AWS Graviton5 處理器(預覽),實現了重大架構突破。這款處理器在單一封裝中提供 192 個核心,實現統一快速的記憶體存取,無需跨 CPU 互連。L3 快取容量是前一代的 5 倍以上。在散熱設計上,AWS Graviton5 移除了傳統的保護蓋和一層導熱材料,採用直接接觸晶片的冷卻方案,風扇功耗降低 33%。基於 AWS Graviton5 的 M9g 執行個體比 M8g 效能提升 25%,提供 Amazon EC2 中最佳性價比。

圖說:AWS 運算與機器學習服務副總裁 Dave Brown。

客戶驗證的真實效能

早期客戶已在正式環境中驗證了 AWS Graviton5 的卓越效能。Airbnb 實現了 25% 的效能提升,Atlassian 延遲降低 20%,Honeycomb 每核心效能提升 36%,SAP HANA OLTP 查詢效能提升 60%。

圖說:客戶驗證的真實效能。

Apple 的 Swift on AWS Graviton 實踐

Apple 雲端系統與平台副總裁 Hiroshi Lockheimer 分享了 Apple 服務在 AWS 上執行的經驗。透過將核心服務用 Swift 重寫並移轉到 AWS Graviton,Apple 實現了 40% 的效能提升和 30% 的成本降低。Swift 語言的安全性、現代設計和內建資安特性使其成為伺服器端開發的理想選擇。Apple 已開源 Swift,並與 AWS 合作為 Amazon Linux 提供了首個官方 Swift 工具鏈套件。

圖說:AWS Graviton.

AWS Lambda Managed Instances:重新定義 Serverless 運算

重新定義 Serverless

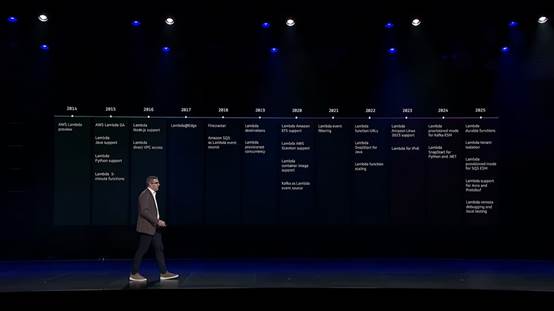

Dave Brown 講述了 AWS Lambda 誕生的故事。2013 年,一個小團隊提出了一個看似不可能的想法:開發者只需交付程式碼,無需管理伺服器。這個想法源於 Amazon S3 團隊處理圖片縮圖的需求,最終演變為 AWS Lambda 這項革命性服務。AWS Lambda 改變了應用程式開發模式,讓開發人員從程式碼而非伺服器開始思考。十年後,AWS Lambda 仍然是從想法到正式環境的最快路徑之一。

圖說:Dave Brown 講述了 AWS Lambda 誕生的故事。

AWS Lambda Managed Instances 的突破

這項創新兼具 Serverless 簡潔性與基礎設施控制。AWS Lambda Managed Instances 在客戶賬戶內的 Amazon EC2 執行個體上運作 Lambda 函數,客戶選擇執行個體類型和硬體,AWS Lambda 管理配置、快取、可用性和擴展。現有 Lambda 函數無需修改即可使用,客戶可同時獲得 Amazon EC2 的效能特性和 AWS Lambda 的開發體驗,這為影片處理、機器學習前置處理、高吞吐量分析等傳統上不適合 AWS Lambda 的工作負載打開了大門。

正如 Dave Brown 所說:「Serverless 的本質從來不是沒有伺服器,而是沒有伺服器管理。」

圖說:AWS Lambda Managed Instances。

Project Mantle:為推論工作負載量身打造

推論工作負載的獨特挑戰

Dave Brown 深入分析了推論請求的四階段流程:分詞、預填滿、解碼、去分詞。每個階段對系統資源的需求完全不同,有的CPU 密集、有的 GPU 運算密集、有的記憶體頻寬密集、有的延遲敏感。在全球規模下,數千客戶、數百萬請求、數十個模型同時執行,每個請求的資源配置檔在流程中動態變化,這是完全不同的擴展挑戰。

Project Mantle 的架構創新

AWS 從零開始 設計了 Project Mantle 推論引擎,現已為 Amazon Bedrock 的許多模型提供支持。

在服務層級上,系統允許客戶將請求分配到三個通道:Priority 通道提供即時低延遲,Standard 通道提供穩定可預測的效能,Flex 通道適合背景任務且效率優先。每個客戶擁有獨立佇列,一個客戶的突發情況不會影響其他客戶效能。系統使用類似 Amazon DynamoDB 和 Amazon S3 的 Journal 系統持續捕獲請求狀態,故障時可從中斷處復原而非重新開始。

在排程方面,微調作業成為長時間執行的任務,即時流量激增時暫停,流量下降時恢復,無需單獨的訓練集群。系統還集成了機密運算/私密運算保護模型權重和客戶資料,提供加密保證。這些創新帶來更一致的延遲、更高的吞吐量、更好的利用率和更強的系統韌性。

圖說:Project Mantle 推論引擎已為 Amazon Bedrock 的許多模型提供支持。

向量搜索:連接非結構化資料

Peter DeSantis 指出,人腦不僅看到像素,還能理解物理屬性、表情和關聯。向量讓電腦以類似方式執行,將資料點放置在數學空間中,透過相對位置發現有趣的關聯。真實的向量編碼空間可能有 3000 個維度,每個維度代表 AI 嵌入模型從大量資料中學習到的未定義概念。

Amazon Nova 多模態嵌入模型

AWS 推出了業界領先的 Amazon Nova 多模態嵌入模型,支援文本、文件、影像、視訊和音訊,將所有這些概念轉換為共享向量空間,創建對資料的統一理解。AWS 將向量能力集成到所有資料服務中,讓客戶無需學習全新技術堆疊。

跨服務的向量能力

Amazon OpenSearch Service從精確比對搜索演進為向量驅動的智能引擎,其混合搜索能力兼具關鍵詞搜索的精確性與語義搜索的深度理解價值。Amazon S3 Vectors 將向量儲存能力整合至最大的資料服務 Amazon S3 中,Amazon S3 原生成本結構與海量規模為向量資料庫提供強力支援,可實現數十億級向量的亞100 毫秒級 查詢響應。同時,產業內其他資料庫和分析服務也在新增向量搜索能力。

圖說:Amazon S3 Vectors。

客戶案例:TwelveLabs 的視訊理解

視訊 AI 公司 TwelveLabs 使用 Amazon S3 Vectors 為其 Marengo 和 Pegasus 基礎模型提供支援,高效處理數百萬小時視訊。Amazon S3 Vectors 使他們能夠直接在儲存來源視訊的 Amazon S3 儲存貯體中儲存數十億嵌入向量,無需資料移轉或重新架構,顯著改善了客戶的單位經濟效益。Arc XP 使用 TwelveLabs 模型快速分析和豐富檔案視訊內容,精確發現相關片段以建構新聞故事。

Amazon Trainium:全面突破的 AI 晶片

Amazon EC2 Trn3 UltraServers:效能全面升級

Peter DeSantis 展示了 Amazon EC2 Trn3 UltraServers 驚人的技術規格:144 顆 Amazon Trainium3 晶片橫跨兩個機架組合成單一 AI 超級電腦,提供 360 petaflops FP8 運算能力,比 Amazon Trn2 UltraServers 高 4.4 倍。20TB 高頻寬記憶體提供 700TB/s 記憶體頻寬,比前一代 高 3.9 倍。執行 GPT-OSS-120B 模型時,每兆瓦輸出 token 數是 Amazon Trainium2 的 5 倍以上。

圖說:Peter DeSantis 展示了 Amazon EC2 Trn3 UltraServers 驚人的技術規格。

系統級創新

Amazon Trainium3 伺服器展示了多項系統級創新。其首次在同一伺服器板上整合 Amazon Trainium、AWS Graviton 和 AWS Nitro 三種自行研發晶片。所有元件頂部可維護,支援 完全機器人組裝,加快部署 速度。專屬 神經元交換器 提供全雙向頻寬 和超低延遲。透過 Elastic Fabric Adapter 實現數千個 Amazon Trainium 伺服器 直接記憶體共享。

晶片架構持續優化

Amazon Trainium3 晶片 整合 多項微架構優化技術,這些優化雖未呈現在官方規格表中卻能顯著提升真實客 工作負載的執行效率,具體涵蓋微縮放、更快的 Softmax 運算、張量解參照、背景轉置、流量整形、記憶體新增寫入及記憶體分散等核心技術。

Amazon Trainium4:效能將持續領先

Peter DeSantis 揭露 Amazon Trainium4 正在開發中,承諾提供比 Amazon Trainium3 高 6 倍的 FP4 運算效能、4 倍記憶體頻寬 和 2 倍高頻寬記憶體容量。這將確保了 AWS 在 AI 晶片領域的長期領先地位。

開發工具全面升級

- Neuron Kernel Interface:將於 2026 年第一季 正式發布,結合 矩陣操作簡潔性與指令級硬體存取能力,採用全端開源設計。

- Neuron Profiler:利用晶片上的專屬硬體進行效能分析,不影響正式環境程式碼效能。

- Neuron Explorer:提供直覺介面展示詳細分析資料,自動偵測瓶頸並建議優化。

- PyTorch 原生支援:預計明年初發布,只需將程式碼從 .to("cuda") 變更為 .to("neuron") 即可在 Amazon Trainium 上執行。

圖說:Neuron Kernel Interface。

客戶案例:Anthropic 與 Descartes AI

Anthropic 在 Amazon Trainium 上訓練和執行 Claude 最新一代模型。Descartes AI 使用 Amazon Trainium3 和Neuron Kernel Interface優化即時視訊生成模型,實現了 4 倍畫面播放速率效能提升和 80% 的張量核心使用率,遠超傳統 GPU 系統。

Descartes AI 在 re:Invent 2025 現場,展示了革命性的「即時視覺智慧」技術,能夠即時生成每一畫面並將講者無縫轉換為動畫角色,全程零延遲執行。這項技術將應用於即時體育賽事、遊戲、購物和機器人模擬訓練。

結語:引領 AI 時代的基礎設施

Peter DeSantis 總結道,AI 對基礎設施的意義是讓基本屬性比以往任何時候都更重要。從 Amazon Nitro 到 Amazon Graviton 到 Amazon Trainium 的持續投入不僅是為了解決過去的技術痛點,更是為了全力迎接 Agentic AI 新時代的到來。而今天展示的成果證明了 AWS 在雲端基礎設施領域的卓越地位。

圖說:AI 對基礎設施的意義是讓基本屬性比以往任何時候都更重要。

AI 仍在破曉之初,未來藏著未知轉折與無限變數,新架構將破土而出,新可能性將陸續迸發。AWS 將如過去二十載般始終在場,移除限制,提供構成要素,協助客戶駕馭未來的一切可能。

What will you build next? 這不僅是一個問題,更是向所有建構者發出的邀請——在卓越的雲端基礎設施上,創造 AI 時代的無限可能。

無法去拉斯維加斯親自體驗?歡迎報名參與Best of AWS re:Invent (AWS 雲端科技發表會) 線上參與,一樣精彩!https://go.aws/48uR2Tx